IA na escrita científica: avanços e implicações éticas

29 de maio de 2024

5 min de leitura

O avanço tecnológico e as ferramentas oriundas da inteligência artificial (IA) transformaram fundamentalmente a paisagem da pesquisa científica. Utilizados desde a concepção do projeto até a análise de dados, novos softwares emergem quase que diariamente como aliados do fazer científico, redesenhando as fronteiras da metodologia de pesquisa. No entanto, também é importante ressaltar os desafios e ruídos que o uso dessas ferramentas pode causar no processo de construção das pesquisas.

A dependência que o uso sem cautela dessas ferramentas pode causar nos pesquisadores serve como alerta de que a tecnologia deve ser usada com precaução (Rolim et al. 2023). Os mecanismos de auxílio à pesquisa devem ser tratados como ferramentas, no sentido que consta nos dicionários: “qualquer instrumento necessário à prática profissional” (Houaiss, 2024). Isso quer dizer que o pesquisador deve utilizar a IA e as tantas oportunidades que advêm dela como apoio – um instrumento para auxiliar no desenvolvimento da pesquisa que possa servir de guia.

Para embasar essa discussão, cabe analisar o livro de Michel Foucault “Vigiar e Punir”, de 1998. Em uma das suas obras mais emblemáticas, o autor revela as intricadas teias do poder e do controle social que permeiam as estruturas institucionais e mostra como a sociedade vai se moldando a partir dos avanços conquistados. Nesse contexto de evolução social, a ascensão da inteligência artificial na pesquisa científica lança luz sobre novas formas de vigilância epistêmica, onde algoritmos e softwares não apenas facilitam a análise de dados, mas também influenciam sutilmente os caminhos do saber.

Em relatório divulgado no último trimestre de 2023 pela Academia Brasileira de Ciências (ABC), um comitê de vários cientistas afirmou que o atraso do cenário científico brasileiro em relação à IA, tanto em termos de incorporação quanto de investimentos, é preocupante e alimenta a “fuga de cérebros” para outros países, o que não contribui para o desenvolvimento da inovação e da ciência no Brasil. Esse quadro pode perpetuar a falta de competitividade do país no futuro.

Curiosidade e ética

A tirinha da Mafalda, reproduzida em 2013 em umas das provas do Exame Nacional do Ensino Médio (ENEM), sobre o processo de modernização e as perspectivas de vida das mulheres no contexto profissional, ilustra a transição de valores e interesses que espelha a própria evolução da ciência e da tecnologia na sociedade.

Assim como a personagem vê na cibernética um campo cheio de promessas, a inteligência artificial representa um horizonte a ser explorado para a escrita científica. Ao abraçar essas ferramentas com curiosidade e ética, é possível continuar a expandir as fronteiras do conhecimento humano e melhorar a comunicação científica, contribuindo, assim, para o avanço nas diversas esferas sociais.

Ao lado do medo que as novas tecnologias impõem a alguns profissionais e, principalmente, para a autonomia e a veracidade da pesquisa na ciência, é essencial abordar a utilidade prática dessas ferramentas e a sua intersecção com o conhecimento científico, além dos paradigmas que moldam nossa compreensão do mundo (Rolim et al. 2023).

Recentemente, uma reportagem publicada no The Guardian mostrou que, em 2023, mais de dez mil artigos em periódicos de todo o mundo foram objeto de retratações (termo em inglês para o ato de “despublicar” um trabalho) por uso indevido e/ou inadequado de IA, ligado a motivos que vão da autoria das informações até o tratamento dos dados apresentados.

Outro fato recente que chamou a atenção e causou preocupação na comunidade científica mundial foi mencionado pelo Jornal da USP, que, em fevereiro de 2024, informou que uma revista de impacto internacional havia publicado um artigo contendo informações incorretas e imagens com erros de proporção. O periódico precisou se retratar três dias depois.

O caso chamou a atenção pelos erros grosseiros e primários que as imagens possuíam, abrindo uma discussão sobre as vertentes éticas e editoriais caso, já que, para ser aprovado, o artigo passou por uma série de etapas avaliativas. Afinal, qual é a responsabilidade que os editores têm sobre as publicações? Vigiar e parametrizar a forma como se usa a IA ou punir, retratando os artigos publicados?

Casos recentes como os relatados por The Guardian e Jornal da USP ressaltam a urgência da discussão sobre o estabelecimento de critérios rigorosos para a utilização de IA na produção científica. A responsabilização tanto dos editores quanto dos autores é crucial, não apenas na validação e verificação dos conteúdos gerados por IA, mas também na manutenção da integridade e da qualidade das publicações.

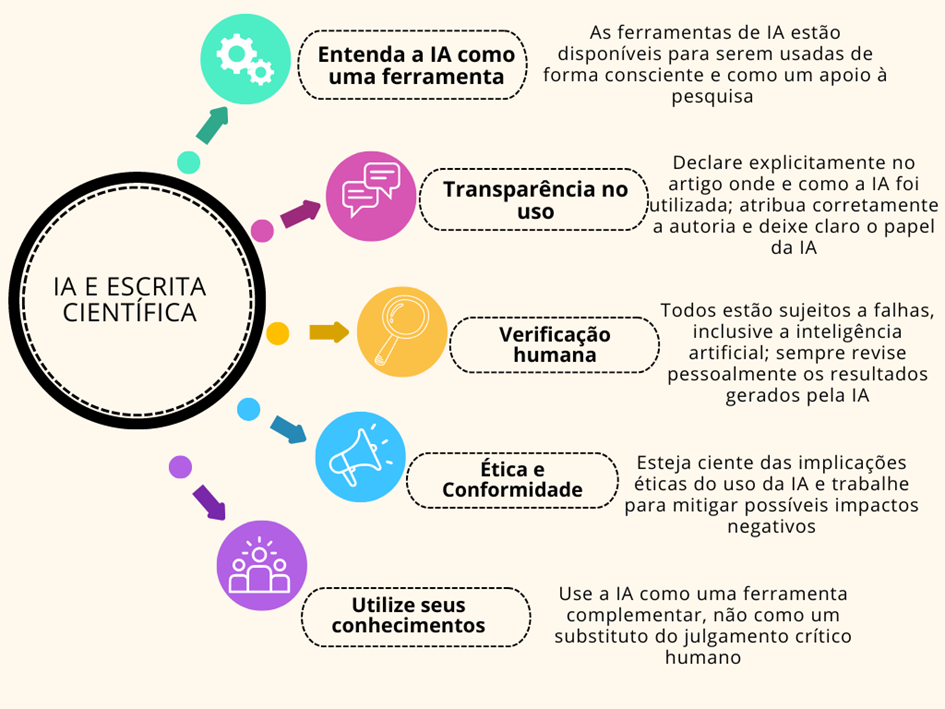

A escolha dessas ferramentas não deve ser meramente técnica; precisa ser embasada por teorias que possam contribuir para a produção do conhecimento de forma ética e respeitando as diretrizes de cada periódico (Rolim et al. 2023). As quebras de paradigmas epistemológicos a partir dos questionamentos que o ser humano vai construindo são positivas e, inclusive, auxiliam na composição das revoluções científicas, guiando a maneira como os estudos são concebidos (Kuhn, 1998). Mas a transformação pode e deve ser paulatina, para não causar danos ao equilíbrio de todo um sistema. A figura abaixo mostra dicas sobre a utilização ponderada da inteligência artificial, como ferramenta de auxílio na pesquisa.

O quadro acima é um exemplo de utilização da inteligência artificial como ferramenta. A figura foi feita com a ajuda de um software para o desenvolvimento do layout e para a elaboração dos pontos mencionados, e seu conteúdo foi adaptado pelo autor a partir de conhecimentos prévios. A intenção aqui ao apresentar a IA como um auxílio para o desenvolvimento de um estudo foi tentar elucidar as funcionalidades práticas dessas ferramentas e problematizar as ramificações mais amplas do seu uso para a produção e a disseminação do saber científico.

Assim como Foucault delineou os mecanismos de poder que moldam as instituições sociais, os pesquisadores contemporâneos enfrentam o desafio de compreender como os softwares de pesquisa e as ferramentas de IA se adaptam não apenas à prática científica, mas também às próprias estruturas do conhecimento e da convivência, como mencionado na tirinha da Mafalda. Afinal, o conhecimento e o uso de IA devem ser colaborativos, seguindo padrões éticos e normativos da ciência e visando uma produção científica de qualidade.

| Para ter acesso às referências desse texto clique aqui |

Este conteúdo foi produzido por:

Luiz Eduardo Giovanelli

Editor assistente da Revista Estratégias e Soluções. Mestrando em Administração pela Universidade de São Paulo. Especialista em Gestão Pública pela Universidade Estadual de Ponta Grossa e graduado em Administração pela Universidade Estadual do Norte do Paraná.